In het verkeer, in de supermarkt of in de fabriek: robots zijn in de nabije toekomst geen standalone machines meer, maar systemen die in dezelfde omgeving als mensen opereren en beslissingen nemen. Dat stelt andere eisen aan ontwerp en ontwikkeling van zulke robots.

“De robot van de toekomst is intelligent en kan zelf beslissingen nemen in een dynamische, veranderende omgeving”, stelt Dr. ir. Joost de Winter, docent en onderzoeker Cognitive Human-Robot Interaction. “Op een abstract niveau is zo’n robot een systeem van sensoren en camera’s die informatie verzamelen, en op basis daarvan intelligente beslissingen neemt die worden geïmplementeerd door actuatoren die de robot doen bewegen. Maar alleen in een volledig geautomatiseerde omgeving als bijvoorbeeld de Rotterdamse haven kun je de mensen buiten beschouwing laten. Er is dus bijna altijd interactie tussen mens en machine.”

Het is een ontwikkeling die goed is terug te zien in De Winters onderzoek naar automatisch rijden. “De laatste jaren is autorijden steeds verder geautomatiseerd. Zo heb je adaptive cruise control, waarbij je niet steeds zelf gas hoeft te geven, en systemen die zelf de rijbaan houden”, legt De Winter uit. Naarmate er meer van zulke toepassingen in auto’s komen, neemt de noodzaak van interactie tussen auto en bestuurder toe. Want al hoeft de bestuurder steeds minder zelf te doen, hij heeft nog steeds een belangrijke rol: ingrijpen als er iets mis gaat. Hoe houd je straks een bestuurder alert die nog maar af en toe in actie hoeft te komen?

Oogbewegingen

Een uitdaging daarbij is dat het traditionele fysieke contact tussen bestuurder en auto aan het verdwijnen is, je hoeft immers steeds minder vaak het stuur of de pedalen aan te raken. Een zelfrijdende auto kan dus geen informatie meer halen uit de aanraking van de besturingselementen. De Winter onderzoekt hoe oogbewegingen daarbij kunnen helpen. “Je kunt met camera’s het kijkgedrag van de mens in de gaten houden. Kijk je even op je dashboard of je telefoon, dan ben je daardoor afgeleid. Als de auto dat detecteert kan die je helpen door feedback of extra assistentie te geven.” Oogbewegingen kunnen ook helpen om het gedrag van voetgangers te voorspellen. “Als er geen oogcontact geweest is, heeft de voetganger het voertuig misschien niet gezien, en kan de auto zijn gedrag aanpassen of de voetganger waarschuwen via een display op de auto.”

Ook de houding en hoofdoriëntatie van de bestuurder in de auto kunnen op die manier aanwijzingen geven. “Zit je bijvoorbeeld meer naar voren, dan betekent dat vaak dat je meer gestrest bent. Zulke informatie kan de auto goed gebruiken: bij een gestreste bestuurder is het waarschijnlijk beter om de snelheid wat te matigen”, vertelt hij. “In het ideale geval ontstaat er een soort van symbiose waarbij toestanden worden uitgewisseld en er nauw wordt samengewerkt tussen voertuig en bestuurder. Dan heb je het beste van twee werelden.”

Zoals een zelfrijdende auto zich in het verkeer tussen andere weggebruikers moet begeven en moet interacteren met de bestuurder, zo zullen robots ook elders steeds vaker opereren in een omgeving met andere robots en met mensen. Denk aan een distributiecentrum van een winkelketen of online warenhuis. “In theorie kun je zulke processen helemaal afschermen en voorgeprogrammeerd laten verlopen. Maar dan zou je alle verstorende factoren moeten kunnen voorspellen en zou de robot intelligent genoeg moeten zijn om zich daaraan aan te passen. In de meeste gevallen zal dat niet lukken. De afgelopen jaren hebben fabrikanten als Boeing en Tesla zelfs weer robots door mensen vervangen in hun productieprocessen.”

In de Cloud

Hoe geautomatiseerd ook, er zullen dus op de meeste werkvloeren mensen aanwezig blijven die technische problemen oplossen, gespecialiseerde taken uitvoeren of in piektijden de werkdruk opvangen. En net als in de auto zal de interactie tussen mens en machine steeds vaker contactloos plaatsvinden, waarbij sensoren en camera’s informatie verzamelen en draadloze besturing en gesture control (handgebaren) de plaats innemen van bedieningspanelen en joysticks. “Onze visie is dat de interactie tussen mens en machine straks in de Cloud plaatsvindt. Daar verzamelt zich de kennis en kan informatie gedeeld worden met de verschillende agents om tot optimale samenwerking te komen.”

Nieuwe masteropleiding

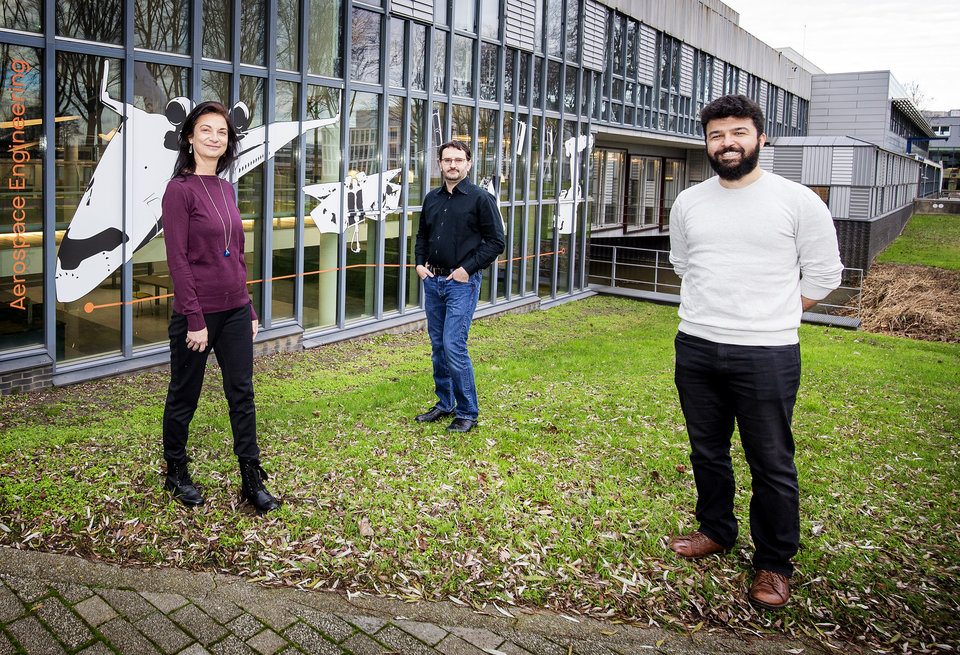

De toenemende mens-machine interactie heeft consequenties voor het vakgebied robotica. Waar het vroeger vooral draaide om de bediening en veiligheid van machines, begeeft robotica zich steeds meer op het kruisvlak van vakgebieden: naast mechanica en artificiële intelligentie spelen ethiek, wet- en regelgeving en sociale aspecten ook een rol. De robotica-ingenieur van de toekomst heeft dan ook een brede basis nodig, dat was de drijfveer voor de oprichting van de nieuwe masteropleiding Robotics. Studenten krijgen een gedegen opleiding in alle technische aspecten van robotica in complexe systemen, en gaan zich daarnaast verdiepen in de sociale aspecten.

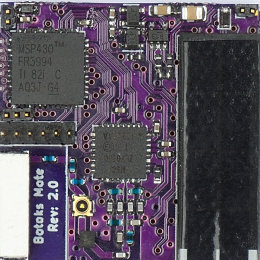

Studenten gaan zelf, individueel en in groepsverband, robots programmeren. “Daarvoor kopen we componenten aan, waar zij de intelligentie aan toevoegen”, vertelt De Winter. “Alle vakken worden gegeven door de meest ervaren docent-onderzoekers. Zo krijgen studenten toegang tot de nieuwste academische inzichten.” Zelf is hij coördinator van de opleiding en doceert hij over de interactie tussen mensen en robots.

Ook de samenwerking met bedrijven speelt een grote rol in het onderwijs. “Studenten gaan projecten bij bedrijven uitvoeren. Ze moeten namelijk niet alleen leren nadenken over de werking van een robot, maar ook over de functie ervan binnen een bedrijf. In hoeverre leg je de verantwoordelijkheid op de werkvloer bij de mens of bij de robot, is bijvoorbeeld een belangrijk vraagstuk.”

Ik denk dan aan een wereld waarin mens en machine cognitieve processen delen en zich aan elkaar aanpassen. Denk aan Knight Rider van vroeger, die intelligente auto die precies begreep wat Michael Knight wou. Al praatte die KITT naar mijn smaak wat te veel.

Transferable skills

Het beantwoorden van zulke vraagstukken vergt meer dan alleen hardcore robotkennis en hands-on programmeerervaring. Uniek voor deze opleiding is dat studenten naast tentamens en projecten een portfolio van zogenaamde transferable skills opbouwen: communicatieve vaardigheden, leiderschap, probleemoplossend vermogen enz. “In een visiedocument moeten ze beschrijven wat voor soort ingenieur ze willen worden. Willen ze zich bezighouden met interactie in die complexe omgeving of juist een robotarm ontwerpen die onder gecontroleerde condities zijn werk doet? Willen ze onderzoek doen of het management in? En voor hun afstuderen vragen we ze te reflecteren op hun ontwikkeling en ervaringen.”

De opleiding speelt in op de vraag uit de markt en is opgezet in samenwerking met de industrie. “Er zijn sectoren waar nu al veel potentie is voor robotisering, denk aan de pakketbezorging. Andere bedrijven willen zo juist proberen een voorsprong te krijgen op de concurrentie. Ze maken allemaal graag gebruik van de kennis van (aankomend) robotica-ingenieurs.” De opleiding bouwt daarmee voort op de samenwerking binnen RoboValley, de Delftse innovatiehub voor robotica. Studenten kunnen verder gebruik maken van de faciliteiten van roboticaproeftuin RoboHouse. Al die robotica-bedrijvigheid rond de campus biedt studenten volop mogelijkheden voor stages en bedrijfsprojecten.

Open Science

Ook in zijn eigen onderzoek werkt De Winter nauw samen met het bedrijfsleven. Wel is voor hem van belang dat dit dan tot een wetenschappelijk artikel leidt. Hij is een groot voorstander van open en transparant onderzoek. Onlangs ontving hij voor zijn inspanningen op dit gebied een Open Science Award.

“Er is veel discussie over reproduceerbaarheid van experimenten. Als je vroeger een vraag kreeg over een eerdere publicatie, moest je op oude harddisks gaan zoeken naar software en data. Tegenwoordig publiceer ik mijn datasets en code op data.4TU. Dat is een vorm van publieke verantwoording. Bovendien, softwareontwikkeling kost vaak duizenden uren en honderdduizenden euro’s. Als dat met publiek geld gefinancierd wordt, moet je dat ook breed toegankelijk maken.”

Waar die data en ideeën op lange termijn toe moeten leiden, heeft hij een duidelijk beeld over: een toekomst waarin de robot de mens echt begrijpt.“Ik denk dan aan een wereld waarin mens en machine cognitieve processen delen en zich aan elkaar aanpassen. Denk aan Knight Rider van vroeger, die intelligente auto die precies begreep wat Michael Knight wou. Al praatte die KITT naar mijn smaak wat te veel”, zegt hij.

Ondanks alle problemen ziet hij de huidige crisis wel als een katalysator in die richting. “Waar we nu inzitten met Covid-19 is niet prettig. Ik merk dat mensen om me heen het lastig vinden en de motivatie van studenten is ook een probleem. Maar die filosofie waarbij kennis in de Cloud wordt gedeeld, sluit hier goed bij aan. De toegenomen digitalisering, het niet meer van negen tot vijf hoeven werken enz., zijn volgens mij goede maatschappelijke ontwikkelingen.”

Lees ook:

- Joost de Winter over open data en replicatieonderzoek

- Website van Joost de Winter

- Eisma, Y. B., Van Bergen, S., Ter Brake, S. M., Hensen, M. T. T., Tempelaar, W. J., & De Winter, J. C. F. (2020). External human-machine interfaces: The effect of display location on crossing intentions and eye movements. Information, 11, 13.

Eigenlijk is De Winter al heel lang met data bezig. “Ik was een tijdje terug op een reünie van de middelbare school en vertelde wat ik nu doe. Men was verrast over de gelijkenis met wat ik vroeger deed. Ik speelde vroeger heel veel computerspellen en analyseerde dan bijvoorbeeld op basis van de data van racespellen hoe goed mensen presteerden”, herinnert hij zich. “Ik werkte ook zelf op circuits in de tijdwaarneming, waar ik ook data verzamelde. Wat ik nu doe is haast een hobby die mijn werk geworden is.”