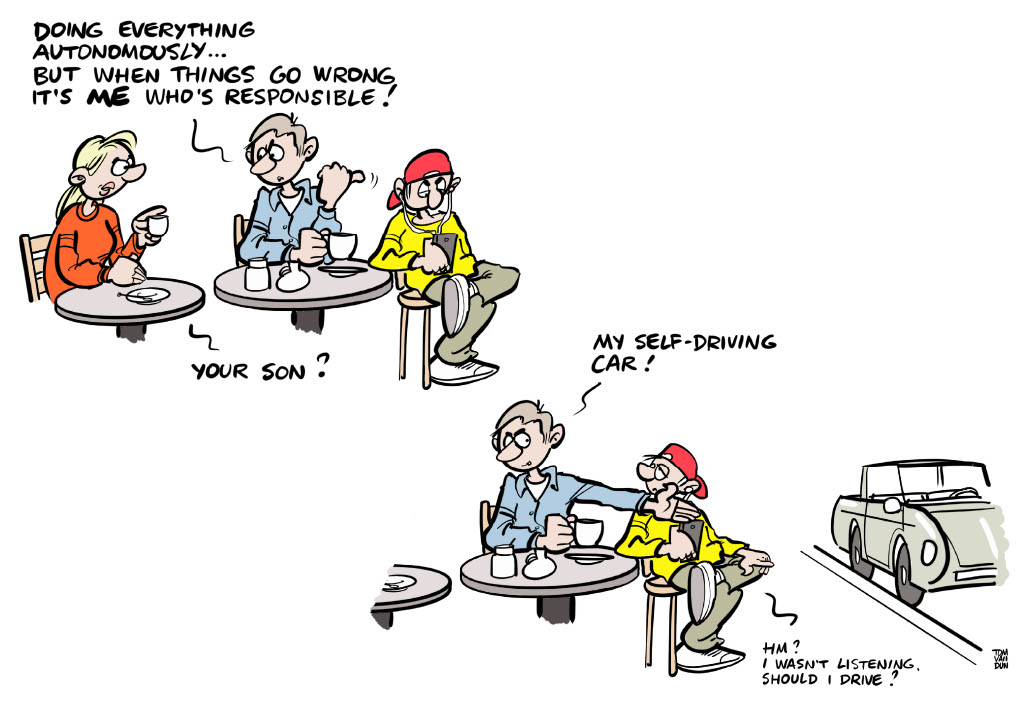

Bestuurders van zelfrijdende auto’s krijgen de schuld van ongevallen die zij redelijkerwijs niet kunnen vermijden

De menselijke bestuurder wordt gezien als eerste verantwoordelijke wanneer zijn of haar (gedeeltelijk) geautomatiseerde auto verongelukt. Maar is dat wel redelijk?

Wetenschappers van het AiTech Institute van TU Delft onderzochten de wanverhouding tussen de schuldvraag van het publiek en de bevindingen uit de literatuur over het vermogen van mensen om waakzaam te blijven tijdens geautomatiseerd rijden. Hun bevindingen zijn onlangs gepubliceerd in Nature Scientific Reports. Bij het experiment dat ze deden, bleek dat deelnemers vooral de bestuurder de schuld van ongevallen gaven, ook al erkenden ze het verminderde vermogen van de bestuurder om ze te vermijden.

Het experiment brengt een kloof aan het licht tussen verwijtbaarheid en verantwoordelijkheid. In deze “aansprakelijkheidskloof” is de verantwoordelijkheid niet redelijk verdeeld. De bestuurder krijgt de meeste schuld, maar mist soms het vermogen om het resultaat te veranderen. Het publiek verwacht dat bestuurders waakzaam blijven en te allen tijde toezicht houden op het geautomatiseerde voertuig, maar we weten dat dit een onredelijke eis is voor een menselijke bestuurder; zelfs hoogopgeleide piloten hebben moeite met het langdurig toezicht houden op automatische pilootsystemen. Bestuurders zijn zich niet bewust van wat er in hun omgeving gebeurt, en ze kunnen niet zo snel reageren als het systeem vereist.

De bevindingen van dit paper kunnen gevolgen hebben voor de toekomst van zelfrijdende auto’s. Op basis van de argumenten van de deelnemers, lijkt het erop dat de meerderheid van hen geen rekening houdt met het eerder genoemde verminderde vermogen van de bestuurder bij geautomatiseerd rijden. Dit zou erop kunnen wijzen dat mensen zich niet bewust zijn van sommige effecten van automatisering, wat zou kunnen leiden tot "ongewilde omissies". Bestuurders zijn zich op hun beurt niet bewust ervan dat geautomatiseerd rijden gevolgen heeft voor hun vermogen om vereiste rij-taken uit te voeren, maar worden toch verantwoordelijk beschouwd.

Het AiTech Institute gaat uit van het concept van ‘meaningful human control over AI systems’, met andere woorden: mensen en niet computers of algoritmen blijven moreel verantwoordelijk voor beslissingen. “Het AiTech Institute leidt interdisciplinair onderzoek rondom het concept van ‘meaningful human control over AI systems’. Dit concept kan niet vanuit één discipline bestudeerd worden, en dus stimuleert AiTech onderzoekers uit verschillende vakgebieden elkaars wetenschappelijke taal te leren en dan samen aan complexe vraagstukken te werken, zoals het onderwerp van deze studie”, aldus wetenschappelijk directeur en hoogleraar David Abbink. De onderzoekers betogen in dit geval dat de verantwoordelijkheid die aan een bestuurder wordt toegekend, wel in overeenstemming moet zijn met zijn vermogen om het geautomatiseerde voertuig te besturen. Als dat vermogen wordt aangetast door het gebruik van de automatisering, moet de verantwoordelijkheid verschuiven van de bestuurder naar de automatisering (of de fabrikant ervan), wat de vraag doet rijzen of de beoordelingen van onze deelnemers redelijk zijn. Een oplossing voor het probleem zou het verstrekken van meer publieke informatie kunnen zijn, over de uitdagingen in verband met geautomatiseerd rijden, of bijvoorbeeld een opleiding voor bestuurders van geautomatiseerde auto’s.

MEER INFORMATIE

Klik hier om de volledige paper te lezen, geschreven door Niek Beckers, Luciano Cavalcante Siebert, Merijn Bruijnes, Catholijn Jonker en David Abbink.